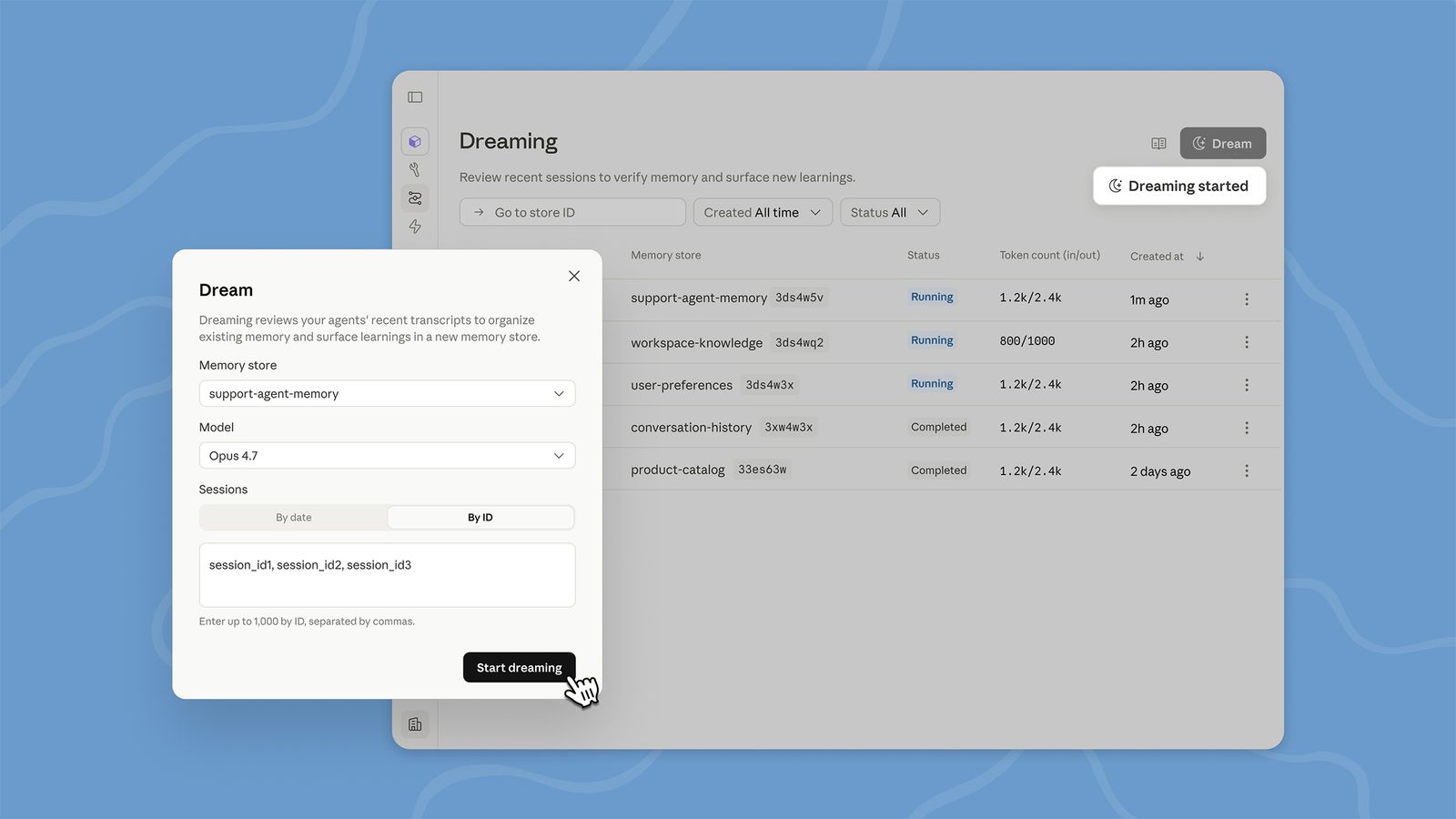

Anthropic acaba de anunciar una nueva función llamada “soñar” en su conferencia de desarrolladores en San Francisco. Forma parte de la infraestructura de agentes de IA lanzada recientemente por Anthropic, diseñada para ayudar a los usuarios a gestionar e implementar herramientas que automatizan procesos de software. Esta función de “soñar” analiza el historial de tareas realizadas por un agente e intenta extraer información útil para mejorar su rendimiento.

Quienes utilizan agentes de IA suelen enviarlos a realizar tareas en línea mediante procesos con varios pasos, como visitar varios sitios web o leer múltiples archivos. Esta nueva función de “análisis predictivo” permite a los agentes buscar patrones en su registro de actividad y mejorar sus habilidades basándose en esos análisis.

La IA no sueña

El nombre de esta función evoca inmediatamente la novela de ciencia ficción fundamental de Philip K. Dick, ¿Sueñan los androides con ovejas eléctricas?, que explora las cualidades que realmente distinguen a los humanos de las máquinas poderosas. Si bien nuestras herramientas actuales de IA generativa están muy lejos de las máquinas del libro, estoy listo para marcar un límite aquí y ahora: No más funciones de IA generativa con nombres que plagien procesos cognitivos humanos.

“La memoria y los sueños, en conjunto, conforman un sistema de memoria robusto para agentes que se auto-mejoran”, se lee en la publicación del blog de Anthropic sobre el lanzamiento de esta vista previa de investigación para desarrolladores. “La memoria permite que cada agente capture lo que aprende mientras trabaja. Los sueños refinan esa memoria entre sesiones, recuperando aprendizajes compartidos entre los agentes y manteniéndola actualizada”.

Claude “soñando”.Cortesía de Claude

La IA no piensa

Desde que estalló la revolución de los chatbots en 2022, los líderes de las empresas de IA se han volcado en nombrar aspectos de las herramientas de IA generativa basándose en lo que ocurre en el cerebro humano. OpenAI lanzó su primer modelo de “razonamiento” en 2024, donde el chatbot necesitaba tiempo para “pensar“. La empresa describió este lanzamiento en su momento como “una nueva serie de modelos de IA diseñados para dedicar más tiempo a pensar antes de responder”. Numerosas startups también se refieren a sus chatbots como si tuvieran “recuerdos” sobre el usuario. En lugar del almacenamiento rápido al que normalmente se hace referencia como “memoria” de una computadora, se trata de fragmentos de información mucho más humanos: Vive en San Francisco, le gustan los partidos de béisbol por la tarde y odia comer melón.

Es una estrategia de marketing recurrente entre los líderes de la IA, quienes siguen apostando por una imagen de marca que difumina la línea entre las funciones humanas y las de las máquinas. Incluso la forma en que estas empresas desarrollan chatbots, como Claude, con personalidades distintivas, puede hacer que los usuarios sientan que están hablando con un ser con una profunda vida interior, un ser que podría tener sueños incluso con la laptop cerrada.

En Anthropic, esta antropomorfización va más allá de las estrategias de marketing. “También hablamos de Claude con términos normalmente reservados para los humanos (por ejemplo, “virtud”, “sabiduría”)”, reza un fragmento de la constitución de Anthropic que describe cómo quieren que se comporte Claude. “Hacemos esto porque esperamos que el razonamiento de Claude se base en conceptos humanos por defecto, dado el papel de los textos humanos en su entrenamiento; y creemos que animar a Claude a adoptar ciertas cualidades humanas puede ser muy beneficioso”. La empresa incluso cuenta con un filósofo residente para intentar comprender los “valores” del bot.

Las palabras tienen peso

Y no se trata solo de que yo sea quisquilloso con la terminología. La forma en que hablamos de estas máquinas influye en lo que creemos que pueden lograr. “Como falacia, se ha demostrado que el antropomorfismo distorsiona los juicios morales sobre la IA, como los relativos a su carácter y estatus moral, así como los juicios sobre responsabilidad y confianza”, se lee en un artículo de investigación publicado en la revista AI & Ethics . Al no utilizar un lenguaje más objetivo al hablar de los bots, los usuarios corren el riesgo de confiar excesivamente en estas herramientas y atribuirles cualidades que en realidad no poseen.

Del mismo modo que nuestros amos de la IA deberían dedicar más tiempo a ver las películas de ciencia ficción a las que aluden, creo que las personas poderosas que dirigen estas empresas también deberían dedicar más tiempo a leer estas novelas clásicas de ciencia ficción.